اختراق جديد في الذكاء الاصطناعي.. GPT-4o يدمج النص والصوت والرؤية

بوابة الذكاء الاصطناعي - وحدة المتابعة

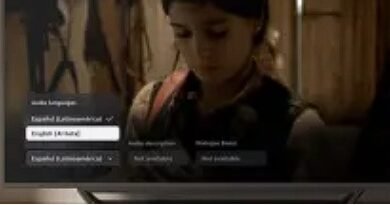

أعلنت شركة OpenAI عن إطلاق نموذجها الجديد الرائد GPT-4o، الذي يجمع بشكل متكامل بين مدخلات ومخرجات النص والصوت والرؤية، مما يعد تطوراً ملحوظاً في تحسين تفاعل الآلة مع البشر.

يتميز GPT-4o، الذي يحمل حرف “o” للإشارة إلى “شامل”، بقدرته على استقبال أي مزيج من النص والصوت والصور، وتوليد أي مزيج منها كمخرجات. وتشير الشركة إلى أن استجابات النموذج تتسم بالسرعة، إذ يصل متوسط زمن الاستجابة إلى 320 مللي ثانية فقط.

ويمثل GPT-4o قفزة نوعية عن سابقيه، باعتماده على شبكة عصبية موحدة لمعالجة كافة المدخلات والمخرجات. ويمكن للنموذج الجديد الاحتفاظ بالمعلومات والسياق الحرجة التي كان يتم فقدانها في المرات السابقة.

ووفقاً للتقرير، فإن GPT-4o يتفوق على الطرازات السابقة في عدد من الجوانب، ومنها فهم الصوت واللغات المتعددة والرؤية. ويمكنه القيام بمهام معقدة كتوليف الأغاني والترجمة الفورية وإنشاء مخرجات تتسم بعناصر تعبيرية كالضحك والغناء.

وعلق ناثانييل ويتمور، المؤسس والرئيس التنفيذي لشركة Superintelligent، على هذا الإنجاز بالقول: “إن إعلانات المنتجات ستكون أكثر انقساماً من إعلانات التكنولوجيا، لأنه من الصعب معرفة ما إذا كان المنتج سيكون مختلفاً حقاً حتى نتفاعل معه فعلياً. وعندما يتعلق الأمر بطريقة جديدة للتفاعل بين الإنسان والكمبيوتر، هناك مزيد من المجال للآراء المتنوعة حول مدى فائدته.”

هذا المحتوى تم باستخدام أدوات الذكاء الاصطناعي